Reinforcement Learning

2026-04-15

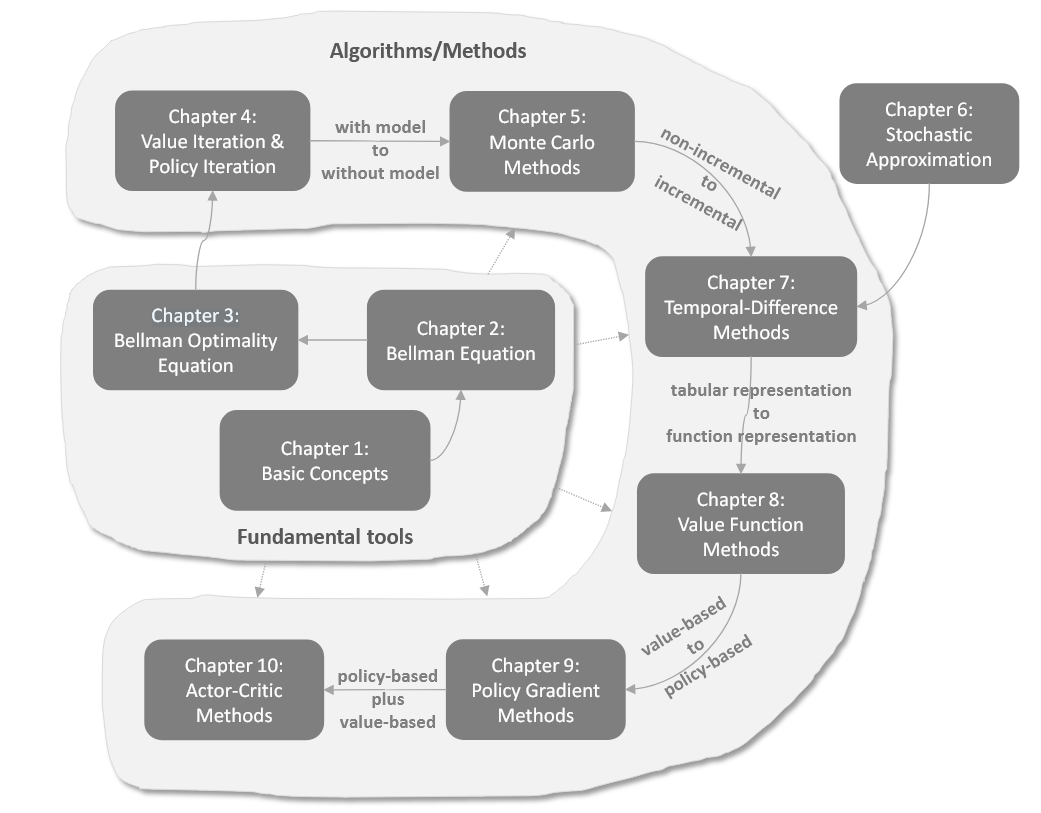

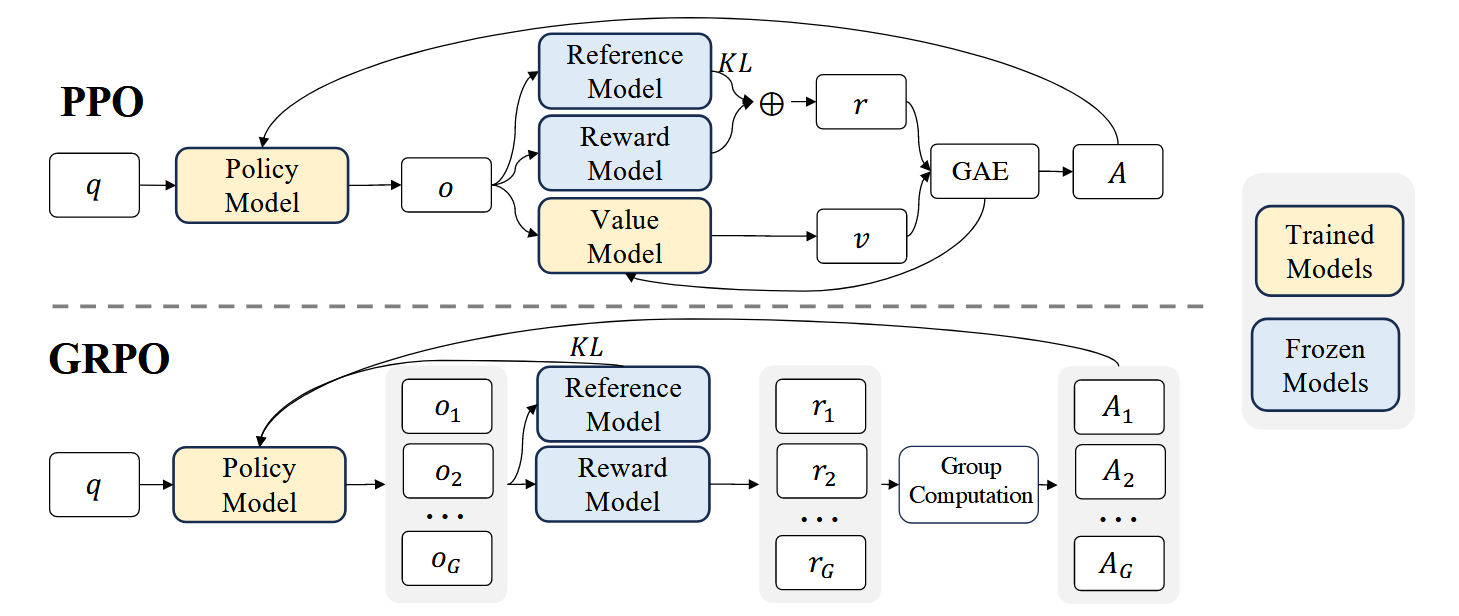

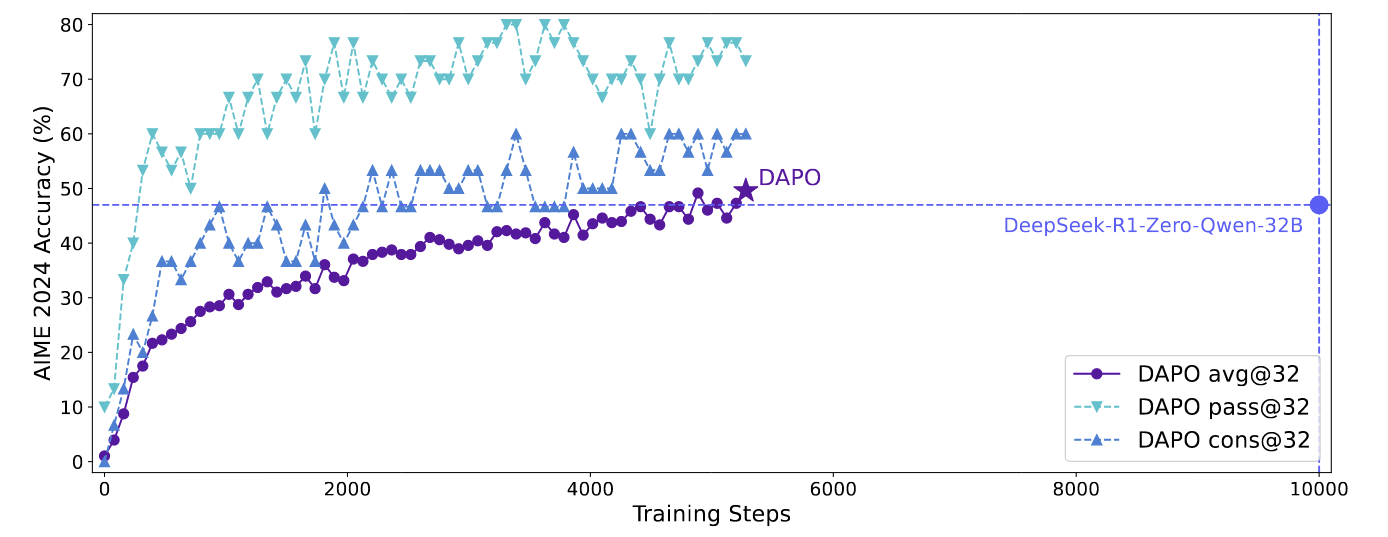

强化学习基础 RL基础概念 贝尔曼方程(Bellman Equation) 贝尔曼最优方程(Bellman Optimality Equation) 价值迭代和策略迭代 强化学习Model-Free之蒙特卡洛 强化学习Model-Free之时序差分 从价值函数到DQN 策略梯度方法(Policy Gradient Methods) Actor-Critic Methods 改进算法 从DPG到DDPG Policy Gradient 优化:TRPO,PPO LLM中的RL RLHF in LLM DPO(Direct Preference Optimization) GRPO(Group Relative Policy Optimization) 从GRPO到GSPO、DAPO