本文仅对一些常见的优化方法进行直观介绍和简单的比较,各种优化方法的详细内容及公式只好去认真啃论文了,在此我就不赘述了。

SGD

此处的SGD指mini-batch gradient descent,关于batch gradient descent, stochastic gradient descent, 以及 mini-batch gradient descent的具体区别就不细说了。现在的SGD一般都指mini-batch gradient descent。

SGD就是每一次迭代计算mini-batch的梯度,然后对参数进行更新,是最常见的优化方法了。即:

其中,\(\eta\) 是学习率,\(g_t\)是梯度 SGD完全依赖于当前batch的梯度,所以\(\eta\) 可理解为允许当前batch的梯度多大程度影响参数更新

缺点:(正因为有这些缺点才让这么多大神发展出了后续的各种算法)

- 选择合适的learning rate比较困难 - 对所有的参数更新使用同样的learning rate。对于稀疏数据或者特征,有时我们可能想更新快一些对于不经常出现的特征,对于常出现的特征更新慢一些,这时候SGD就不太能满足要求了

- SGD容易收敛到局部最优,并且在某些情况下可能被困在鞍点

Momentum

momentum是模拟物理里动量的概念,积累之前的动量来替代真正的梯度。公式如下:

其中,\(\mu\) 是动量因子

特点:

- 下降初期时,使用上一次参数更新,下降方向一致,乘上较大的\(\mu\) 能够进行很好的加速

- 下降中后期时,在局部最小值来回震荡的时候,\(gradient \rightarrow0\),\(\mu\)使得更新幅度增大,跳出陷阱

- 在梯度改变方向的时候,\(\mu\) 能够减少更新。总而言之,momentum项能够在相关方向加速SGD,抑制振荡,从而加快收敛

Nesterov

nesterov项在梯度更新时做一个校正,避免前进太快,同时提高灵敏度。 将上一节中的公式展开可得:

可以看出,\(m_{t-1}\)并没有直接改变当前梯度\(g_t\),所以Nesterov的改进就是让之前的动量直接影响当前的动量。即:

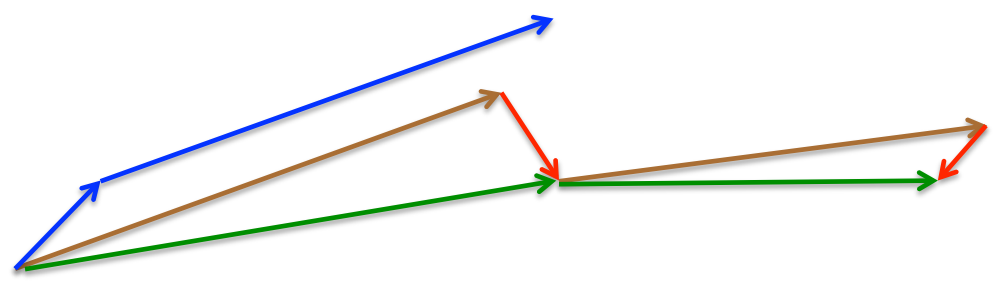

所以,加上nesterov项后,梯度在大的跳跃后,进行计算对当前梯度进行校正。如下图:

momentum首先计算一个梯度(短的蓝色向量),然后在加速更新梯度的方向进行一个大的跳跃(长的蓝色向量),nesterov项首先在之前加速的梯度方向进行一个大的跳跃(棕色向量),计算梯度然后进行校正(绿色梯向量)

其实,momentum项和nesterov项都是为了使梯度更新更加灵活,对不同情况有针对性。但是,人工设置一些学习率总还是有些生硬,接下来介绍几种自适应学习率的方法

Adagrad

Adagrad其实是对学习率进行了一个约束。即:

此处,对\(g_t\)从1到 \(n\) 进行一个递推形成一个约束项regularizer,\(-\frac{1}{\sqrt{\sum_{r=1}^t g_r^2+\epsilon}}\),\(\epsilon\) 用来保证分母非0

特点:

- 前期\(g_t\)较小的时候, regularizer较大,能够放大梯度

- 后期\(g_t\)较大的时候,regularizer较小,能够约束梯度

- 适合处理稀疏梯度

缺点:

- 由公式可以看出,仍依赖于人工设置一个全局学习率

- \(\eta\) 设置过大的话,会使regularizer过于敏感,对梯度的调节太大

- 中后期,分母上梯度平方的累加将会越来越大,使\(gradient\rightarrow0\),使得训练提前结束

Adadelta

Adadelta是对Adagrad的扩展,最初方案依然是对学习率进行自适应约束,但是进行了计算上的简化。 Adagrad会累加之前所有的梯度平方,而Adadelta只累加固定大小的项,并且也不直接存储这些项,仅仅是近似计算对应的平均值。即:

在此处Adadelta其实还是依赖于全局学习率的,但是作者做了一定处理,经过近似牛顿迭代法之后:

其中,\(E\)代表求期望。

此时,可以看出Adadelta已经不用依赖于全局学习率了。

特点:

- 训练初中期,加速效果不错,很快

- 训练后期,反复在局部最小值附近抖动

RMSprop

RMSprop可以算作Adadelta的一个特例:

当\(\rho=0.5\)时,

就变为了求梯度平方和的平均数。如果再求根的话,就变成了RMS(均方根):

此时,这个RMS就可以作为学习率\(\eta\) 的一个约束:

特点:

- 其实RMSprop依然依赖于全局学习率

- RMSprop算是Adagrad的一种发展,和Adadelta的变体,效果趋于二者之间

- 适合处理非平稳目标 - 对于RNN效果很好

Adam

Adam(Adaptive Moment Estimation)本质上是带有动量项的RMSprop,它利用梯度的一阶矩估计和二阶矩估计动态调整每个参数的学习率。Adam的优点主要在于经过偏置校正后,每一次迭代学习率都有个确定范围,使得参数比较平稳。公式如下:

其中,\(m_t\),\(n_t\)分别是对梯度的一阶矩估计和二阶矩估计,可以看作对期望\(E|g_t|\),\(E|g_t^2|\) 的估计;

\(\hat{m_t}\),\(\hat{n_t}\)是对\(m_t\),\(n_t\)的校正,这样可以近似为对期望的无偏估计。 可以看出,直接对梯度的矩估计对内存没有额外的要求,而且可以根据梯度进行动态调整,而\(-\frac{\hat{m_t}}{\sqrt{\hat{n_t}}+\epsilon}\) 对学习率形成一个动态约束,而且有明确的范围。

特点:

- 结合了Adagrad善于处理稀疏梯度和RMSprop善于处理非平稳目标的优点

- 对内存需求较小

- 为不同的参数计算不同的自适应学习率

- 也适用于大多非凸优化 - 适用于大数据集和高维空间

Adamax

Adamax是Adam的一种变体,此方法对学习率的上限提供了一个更简单的范围。公式上的变化如下:

可以看出,Adamax学习率的边界范围更简单

Nadam

Nadam类似于带有Nesterov动量项的Adam。公式如下:

可以看出,Nadam对学习率有了更强的约束,同时对梯度的更新也有更直接的影响。一般而言,在想使用带动量的RMSprop,或者Adam的地方,大多可以使用Nadam取得更好的效果。

小结

- 对于稀疏数据,尽量使用学习率可自适应的优化方法,不用手动调节,而且最好采用默认值

- SGD通常训练时间更长,但是在好的初始化和学习率调度方案的情况下,结果更可靠

- 如果在意更快的收敛,并且需要训练较深较复杂的网络时,推荐使用学习率自适应的优化方法。

- Adadelta,RMSprop,Adam是比较相近的算法,在相似的情况下表现差不多。

- 在想使用带动量的RMSprop,或者Adam的地方,大多可以使用Nadam取得更好的效果

最后展示两张可厉害的图,一切尽在图中啊,上面的都没啥用了... ...

损失平面等高线

在鞍点处的比较

目前主流应用的优化器是AdamW,不过一个新的优化器 Muon(仅仅发布在Github上)似乎比 AdamW优化器能够实现更加优异的效果,于此同时Kimi也出了一篇新的论文就是使用 Muon优化器,有必要了解一些这个优化器以及测试一下这个优化器效果。

AdamW

现在比较主流的优化器是AdamW,AdamW是 Adam 优化器的一个变种,旨在改进 L2 正则化的处理。AdamW 的数学公式可以通过以下几个步骤来描述:

- 动量估计

- 一阶矩(梯度的加权平均):

AdamW 基于梯度的一阶矩(平均梯度)和二阶矩(梯度的平方)进行估计。对于每个参数 \(\theta_t\),算法计算以下量:

其中 \(g_t\) 是当前时刻的梯度,\(\beta_1\) 是衰减率,通常设置为 0.9。

- 二阶矩(梯度平方的加权平均):

其中 \(\beta_2\) 是衰减率,通常设置为 0.999。

- 偏置校正

由于在训练初期,动量估计 \(m_t\) 和 \(v_t\) 都会偏向零,因此需要进行偏置校正。偏置校正公式如下:

- 偏置校正后的动量估计:

- 偏置校正后的二阶矩估计:

- 更新规则

AdamW 的更新规则与传统的 Adam 更新规则相似,但加入了权重衰减(L2 正则化),权重衰减是通过 \(\lambda\) 控制的,其中 \(\lambda\) 是 L2 正则化项的超参数。

更新公式为(Adam计算公式中只有前面两个部分):

其中:

- \(\theta_{t-1}\) 是上一时刻的参数值,\(\theta_t\) 是当前时刻的参数值。

- \(\eta\) 是学习率。

- \(\epsilon\) 是一个小常数,用于避免除零错误,通常设置为 \(10^{-8}\)。

- \(\lambda\) 是权重衰减的超参数(AdamW 中引入的主要不同点)。

- \(\hat{m}_t \)和 \(\hat{v}_t\) 是经过偏置校正的一阶和二阶矩。

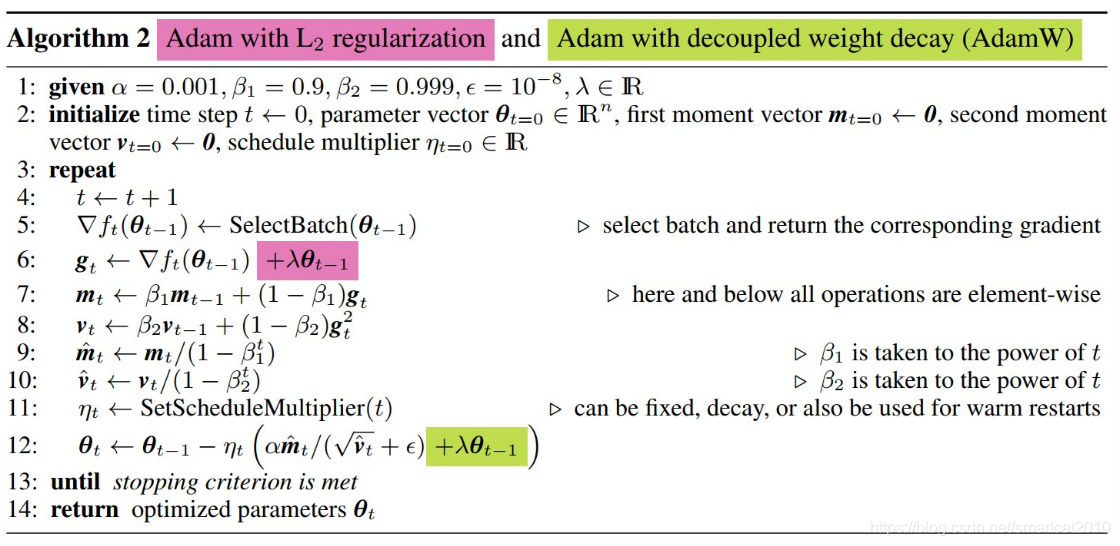

AdamW 相对与Adam的改动十分简单,其将权重衰减项从梯度的计算中拿出来直接加在了最后的权重更新步骤上(下图,式12)。其提出的动机在于:原先Adam的实现中如果采用了L2权重衰减,则相应的权重衰减项会被直接加在loss里,从而导致动量的一阶与二阶滑动平均均考虑了该权重衰减项(下图. 式6),而这影响了Adam的优化效果,而将权重衰减与梯度的计算进行解耦能够显著提升Adam的效果。目前,AdamW现在已经成为transformer训练中的默认优化器了。

Adam vs AdamW

AdamW 的核心贡献在于将权重衰减(Weight Decay)从梯度更新中剥离出来。

- 标准 Adam (配合 L2 正则化)

在标准的深度学习框架实现中(AdamW 出现之前),如果我们想做正则化,通常是向损失函数添加 L2 惩罚项:

此时,梯度的计算包含了正则项的导数 $\lambda \theta$:

问题所在:Adam 会把这个含正则项的梯度 \(g_t'\) 放入 \(m_t\)和 \(v_t\)中计算。

这意味着,权重衰减的力度被 \(\frac{1}{\sqrt{\hat{v}_t}}\) 缩放了。

- 如果某个参数的梯度很大(\(\hat{v}_t\) 很大),那么 \(\frac{1}{\sqrt{\hat{v}_t}}\) 就很小,导致权重衰减的力度也被削弱了。

- 这导致正则化不仅取决于 \(\lambda\),还取决于梯度的历史幅度,这通常不是我们想要的效果。

- AdamW (解耦权重衰减)

AdamW 不修改损失函数的梯度。它直接使用原始梯度 \(g_t = \nabla \mathcal{L}_{original}\) 来计算 \(\hat{m}_t\) 和 \(\hat{v}_t\)。

然后,在更新参数的最后一步,直接减去 \(\eta \lambda \theta_{t-1}\)。

让我们对比两者的更新项:

- Adam (L2 Regularization)

- AdamW (Weight Decay)

总结

- 解耦 (Decoupling):AdamW 将权重衰减项 \(-\eta \lambda \theta_{t-1}\) 独立于自适应学习率 \(\frac{1}{\sqrt{\hat{v}_t}}\) 之外。

- 效果:对于 SGD 来说,L2 正则化和权重衰减是等价的;但对于 Adam 这种自适应算法,它们是不等价的。AdamW 恢复了权重衰减的原始物理意义——每次更新都让权重以固定的比例 \(\eta \lambda\) 向 0 收缩。

- 优势:AdamW 通常比标准 Adam 具有更好的泛化能力,且对超参数(学习率和权重衰减系数)的选择更加鲁棒,这也是为什么现在训练 Transformer(如 BERT, GPT, LLaMA)时默认都使用 AdamW 的原因。

Muon

详情参考:Muon优化器